Privaten Schlüssel (ohne Passphrase) erzeugen:

$ openssl genrsa -out private.pem 2048

Öffentlichen Schlüssel aus privatem Schlüssel erzeugen:

$ openssl rsa -in private.pem -pubout >public.pem

Nachricht mit öffentlichem Schlüssel verschlüsseln:

$ openssl pkeyutl -encrypt -pubin -inkey public.pem -in text.txt -out text.enc

Verschlüsselte Nachricht mit privatem Schlüssel entschlüsseln:

$ openssl pkeyutl -decrypt -inkey private.pem -in text.enc >text.dec

Wie in Einen Offline-Mirror des CPAN erstellen beschrieben, ist es möglich, eine beliebige Kollektion von CPAN-Modulen auf einem Rechner ohne Internet-Zugang zu installieren. Der Offline-Mirror hat aktuell eine Größe von ca. 5GB. Dies läßt sich reduzieren, indem man ihn auf genau die Module beschränkt, die man tatsächlich installieren möchte. Dies geht mit Bordmitteln wie folgt:

Einen Rechner mit Internet-Zugang wählen.

Auf diesem Rechner die benötigten Module in das (frei gewählte) MicroCPAN-Verzeichnis installieren:

$ cpanm --save-dists MICROCPANDIR --local-lib-contained MICRCPANDIR/inst --prompt MODULE ...

Das Verzeichnis um die CPAN Package-Liste ergänzen (diese umfasst alle CPAN-Module, auch wenn wir nur einen Teil davon nutzen):

$ curl -L http://www.perl.com/CPAN/modules/02packages.details.txt.gz --silent --output MICROCPANDIR/modules/02packages.details.txt.gz

Das MicroCPAN-Verzeichnis auf den Zielrechner (ohne Internet-Zugang) übertragen.

Die o.g. Module auf dem Zielrechner offline installieren:

$ cpanm --mirror MICROCPANDIR --mirror-only MODULE ...

Hierbei ist:

Das (frei gewählte) MicroCPAN-Verzeichnis auf dem Quell- und dem Zielrechner

Die Liste der Module, die auf dem Zielrechner offline installiert werden sollen

![]()

Wer in Deutschland einem öffentlichen Auftraggeber eine Rechnung stellen möchte, muss diese u.U. zwingend als XRechnung übermitteln. Was tun, wenn man hierfür keine Software besitzt?

Für gelegentliche Rechnungsstellung bietet sich hierfür das Portal https://xrechnung-bdr.de der Bundesdruckerei an. Dort kann man nach Registrierung die Rechnungsdaten in einem selbsterklärenden Arbeitsablauf eingeben. Nach Abschluss wird die XRechnung erzeugt und anhand der Leitweg-Id automatisch an den Empfänger übermittelt. Dies alles ist kostenfrei.

Eine Authentisierung über LDAP gegen ein Active Directory (AD) besteht im Kern im Aufruf der Methode bind(). Gelingt dieser Aufruf, ist der Benutzer authentisiert:

use Net::LDAP;

my $workgroup = '...';

my $user = '...';

my $password = '...';

my $ldap = Net::LDAP->new(

'ldaps://dc1', # verschlüsselte Verbindung

verify => 'none', # keine Verifikation des Server-Zertifikats (sollte eigetlich 'require' sein)

onerror => 'die', # Exception, wenn wenn nachfolgende Methodenaufrufe fehlschlagen

) or die $@;

$ldap->bind("$workgroup\\$user",password=>$password);

$ldap->unbind;

# ab hier ist der Benutzer authentisiert

In Dateien eines Verzeichnisbaums wollen wir eine mehrzeilige Ersetzung vornehmen. Unter Nutzung von Perl geht dies mit einem Einzeiler:

$ find DIR ... | xargs perl -0777 -p -i -E 's/REGEX/REPLACEMENT/gms'

Hierbei ist REGEX ein Regulärer Ausdruck, der Text über mehreren Zeilen matchen kann. Wie funktioniert der Aufruf?

Perl verarbeitet die Dateien, die von xargs(1) als Argumente übergeben werden, und behandelt sie gemäß den angegebenen Optionen:

Kein Input-Separator, d.h. Perl liest die jeweilige Datei komplett ein statt sie zeilenweise zu verarbeiten. Dadurch wirkt der Perl-Code, siehe Option -E CODE, nicht auf eine einzelne Zeile, sondern auf den gesamten Dateiinhalt.

Perl iteriert über die Dateien, die als Argumente angegeben sind, und gibt den Dateiinhalt jeweils nach Manipulation durch den Perl-Code CODE mit print aus.

Die Ausgabe mit print ersetzt den Inhalt der ursprünglichen Datei (Bearbeitung "in place"). Wird die Option -i mit einem Wert ergänzt, z.B. -i.orig, bleibt die Originaldatei mit der Endung .orig erhalten. Auf diesem Weg kann Code CODE gefahrlos getestet werden.

Der Perl-Code, der auf den Inhalt der Datei angewandt wird. Dieser kann beliebige Manipulationen vornehmen. Wir führen oben ein einzelnes Substitute s/// aus, mit den Optionen g (alle Fundstellen werden ersetzt), m (^ uns $ matchen Zeilenanfang und Zeilenende), s (der Punkt . matcht auch Zeilenumbrüche). Diese Semantik ist in dem gegebenen Anwendungsfall besonders nützlich.

Beispiel

Entferne im Verzeichnisbaum DIR die Inline-Dokumentation (POD) aus allen .pm-Dateien:

$ find DIR -name '*.pm' | xargs perl -0777 -p -i -E 's/^=[a-z].*?^=cut\n//gms'

SQLite ist ein leichtgewichtiges relationales Datenbanksystem, das genial konzipiert, allerdings nicht netzwerkfähig ist. Letzteres ist laut der Autoren Absicht: "SQLite is designed for situations where the data and application coexist on the same machine."

Mitunter möchte man dennoch eine SQLite-Datenbank von einem entfernten Rechner zugreifen. Dass es keine gute Idee ist, wie es im Netz öfter als Lösung genannt wird, die Datenbankdatei (eine SQLite-Datenbank besteht aus einer einzigen Datei) auf ein Netzwerk-Dateisystem zu legen, wird von den Autoren in SQLite Over a Network, Caveats and Considerations dargelegt.

Unter Perl lässt sich der Netzwerk-Zugriff auch solide unter Rückgriff auf DBI und dessen Proxy-Server realisieren. Der Unterschied ist, dass in dem Fall die API Schicht ins Netz verlegt wird und nicht die File-I/O Schicht (s. obiges Dokument).

Starten des Proxy-Servers auf dem Rechner mit der SQLite-Datenbank:

$ ssh USER@HOST "bash -lc 'dbiproxy --localport=PORT'"

Zugriff auf die Datenbank aus Perl heraus von einem beliebigen Rechner aus:

use DBD::SQLite;

my $dbh = DBI->connect('dbi:Proxy:hostname=HOST;port=PORT;dsn=DSN',{

RaiseError => 1,

ShowErrorStatement => 1,

});

# ab hier können wir auf die SQLite-Datenbank zugreifen, als ob sie lokal wäre

Hierbei ist:

Der Name des Rechners, auf dem die SQLite-Datenbank liegt.

Der Port, auf dem der Proxy-Server läuft.

Der DBI Data Source Name der SQLite-Datenbank. Dieser hat die Form dbi:SQLite:dbname=PATH, wobei PATH der Pfad der Datenbank-Datei auf dem entfernten Rechner ist.

Eine breitere Darstellung der Möglichkeiten des DBI Proxy-Servers findet sich in Programming the Perl DBI - Database Proxying.

Warnung: Der DBI Proxy-Server hat offenbar ein Memory Leak und sollte daher nicht unbegrenzt lange laufen.

Soll lediglich mit dem SQLite-Client auf eine entfernte Datenbank zugegriffen werden, kann dies per ssh(1) erreicht werden:

$ ssh -t USER@HOST sqlite3 PATH

![]()

Zahlreiche ältere Bücher von O'Reilly, die nur noch antiquarisch erhältlich sind, können hier online gelesen werden. Vieles ist veraltet, manche Themen sind jedoch nach wie vor relevant und hervorragend dargestellt. Die umfangreiche Sammlung lädt zum Stöbern ein:

Beispiele:

Die Mausunterstützug wird im Emacs-Init-File (~/.emacs.el, ~/.emacs oder ~/.emacs.d/init.el) aktiviert mit:

(xterm-mouse-mode 1)

Auch das Mausrad wird unterstützt. Eine Markierung wird in den Paste-Buffer (Copy & Paste) kopiert, wenn gleichzeitig die SHIFT-Taste gehalten wird. Aus dem Paste-Buffer wird per Default mit SHIFT MOUSE-RIGHT eingefügt. Wer lieber mit der mittleren Maustaste (MOUSE-MIDDLE) einfügen möchte, wie man es von X11 her kennt, kann diese Bedienlogik unter Window / Selection / Action of mouse buttons / xterm aktivieren.

Funktioniert im Emacs die Cursorsteuerung über das Numeric Keypad nicht (das Verhalten ist wie im NumLock-Modus, d.h. anstatt Cursorbewegungungen auszuführen zeigt der Emacs Ziffern an), muss der "Application Keypad mode" in PuTTY abgeschaltet werden. Zu finden ist die Option in den Einstellungen unter Terminal / Features / Disable application keypad mode. Die Cursorsteuerung funktioniert natürlich nur, wenn der NumLock-Modus auf dem Keyboard tatsächlich abgeschaltet ist.

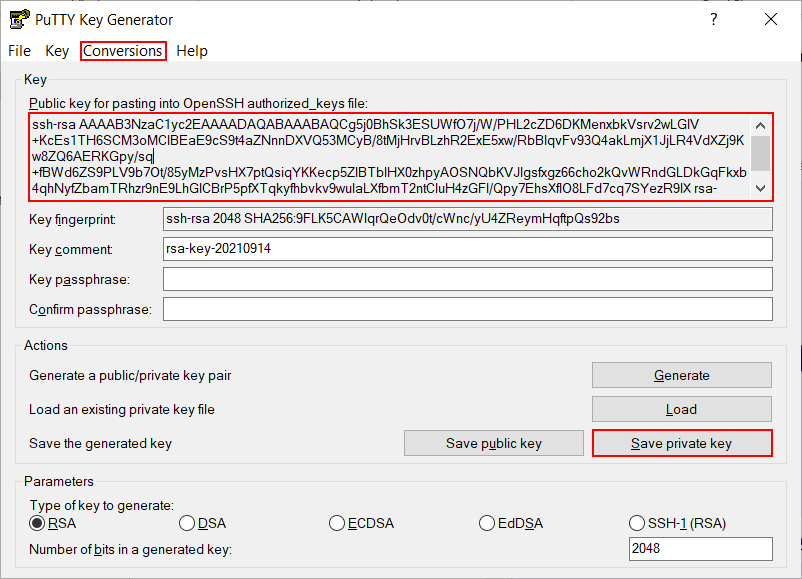

Wir rufen PuTTYgen auf und erzeugen ohne Änderung an den Voreinstellungen durch Betätigung des Buttons Generate ein RSA Schlüsselpaar mit 2048 Bit Schlüssellänge:

Anschließend speichern wir drei Dateien, um in einem Netzwerk aus Windows-Clients und Linux-Servern eine Anmeldung mit Public-Key-Authentisierung einrichten zu können:

Mit Copy & Paste speichern wir den Public Key, der im oberen Bereich des Fensters angezeigt wird, in id_rsa.pub. Den Inhalt dieser Datei fügen wir auf allen Linux-Servern, auf denen wir uns mit Public-Key-Authentisierung einloggen wollen, zur Datei .ssh/authorized_keys hinzu.

Mit Klick auf Save private key speichern wir den Private Key in id_rsa.ppk. Diese Datei machen wir allen Windows-Clientprogrammen bekannt, mit denen wir uns per Public-Key-Authentisierung auf einem Linux-Server einloggen wollen. Im PuTTY-Client z.B. wird der Dateipfad in die Konfiguration eingetragen unter Connection / SSH / Auth / Private key file for authentication.

Verlangt ein Client die PPK-Datei in einem älteren Format (Version 2 statt Version 3), können wir dieses erzeugen, indem wir unter Key / Parameters for saving files ... die Option PPK file version: 2 setzen, bevor wir den Private Key speichern.

Wollen wir uns ferner zwischen Linux-Rechnern per Public-Key-Verfahren authentisieren, erzeugen wir über den Menüeintrag Conversions / Export OpenSSH key den Private Key für Linux und speichern diesen in rsa_id. Diese Datei hinterlegen wir auf den Linux Rechern, von denen aus wir uns auf andere Linux-Rechner per Public-Key-Authentisierung einloggen wollen, in .ssh/rsa_id. Die Datei darf nur für ihren Owner lesbar sein und muss daher mit chmod 600 .ssh/rsa_id gegen fremden Zugriff geschützt werden.

Wir entwickeln auf Basis von Mojolicious eine Webanwendung NAME und möchten, dass diese

Diese Anforderungen lassen sich leicht mit morbo als Webserver in Kombination mit der Prozesssteuerung systemd realisieren. Hierbei ist morbo der Entwicklungs-Webserver von Mojolicious und systemd die fundamentale Prozesssteuerung vieler Linux-Systeme (ein moderner Ersatz für init). Ein zusätzlicher Webserver wie nginx oder apache wird nicht benötigt.

Die Unit-Datei NAME.service, mit der wir den Service gegenüber systemd definieren, ist recht einfach (Erläuterungen zur einzig interessanten Zeile ExecStart siehe im Folgenden):

[Unit]

Description=DESCRIPTION

After=network.target

[Service]

Type=simple

User=USER

ExecStart=bash -lc "morbo PROGRAM --listen http://*:PORT --watch SOURCEDIR --verbose >LOGFILE.log 2>&1"

[Install]

WantedBy=multi-user.target

Hierbei ist:

Eine kurze, einzeilige Beschreibung des Service.

Der Name des Unix-Users, unter dessen Rechten der Prozess ausgeführt wird, denn wir möchten, dass der Prozess im Kontext eines bestimmten Users läuft. Wenn nicht angegeben, ist root der User.

Pfad/Name des Programms, das die Webanwendung ausführt. Wir rufen die Anwendung nicht direkt auf, sondern via bash -lc "...", damit sie in der Umgebung des Users USER läuft.

Port, auf dem die Anwendung läuft. Wegen * ist sie auf allen Interfaces erreichbar, d.h. sie ist zugreifbar via localhost:PORT oder HOSTNAME:PORT.

Wurzelverzeichnis, im dem sich die Quellen der Anwendung befinden. Dieses Verzeichnis überwacht morbo in Bezug auf Änderungen. Verteilen sich die Quellen über mehrere Verzeichnisse, kann die Option --watch mehrfach angegeben werden.

Pfad/Name der Logdatei, in die der Webserver (morbo) die Zugriffe und Fehlermeldungen protokolliert. Die Logdatei wird beim Booten neu begonnen, womit auf einfache Weise vermieden wird, dass sie unbegrenzt wächst, historische Information wird in der Entwicklungsumgebung ja nicht benötigt.

Die systemd Unit-Datei kopieren wir in das Verzeichnis /etc/systemd/system. Mit folgender Kommandofolge machen wir die Anwendung dauerhaft und sofort verfügbar:

# systemctl daemon-reload # Konfigurationsänderung systemd bekannt machen # systemctl enable NAME # Service aktivieren, so dass die Anwendung beim Booten gestartet wird # systemctl start NAME # Service sofort verfügbar machen (ohne Rebooten zu müssen)

Den Status überprüfen wir mit:

# systemctl status NAME

Die Anwendung kann jederzeit gestoppt und gestartet werden mit:

# systemctl stop NAME # systemctl start NAME

Der automatische Start beim Booten lässt sich ab- und anschalten mit:

# systemctl disable NAME # systemctl enable NAME

Die Liste aller vorhandenen Unit-Files und ihres jeweiligen Status:

# systemctl list-unit-files

Vorschlag für eine Verzeichnisstruktur im Homeverzeichnis von USER:

~/etc/systemd/NAME.service # Unit-Datei, per Symlink referenziert von /etc/systemd/system aus, Qwner ist USER ~/var/log/NAME.log # Logdatei ~/opt/NAME/... # Projektverzeichnis

Die konkrete Kommandozeile zum Starten der Anwendung lautet dann:

morbo ~/opt/NAME/bin/PROGRAM --listen http://*:PORT --watch ~/opt/NAME --verbose >~/var/log/NAME.log 2>&1

nohup morbo ~/opt/NAME/bin/PROGRAM --listen http://*:PORT --watch ~/opt/NAME --verbose >~/var/log/NAME.log 2>&1 &

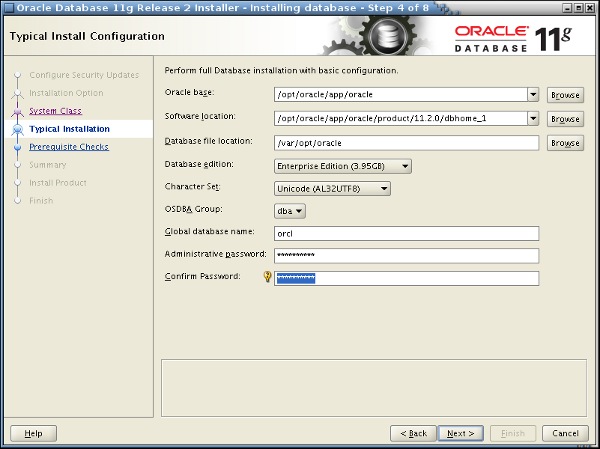

Unter Linux (Debian) bricht eine zuvor funktionierende Oracle-Datenbank beim Hochfahren plötzlich ab. Die Meldung lautet:

ORA-00845: MEMORY_TARGET not supported on this system

Im Netz wird in Blogs als Lösung genannt, man möge /dev/shm mounten

# mount -t tmpfs tmpfs -o size=2g /dev/shm

oder, falls /dev/shm bereits gemountet ist, den Speicher vergrößern

# mount -o remount,size=2g /dev/shm

Dies hat beides allerdings nicht geholfen, da es eine weitere Fehlerursache gibt. Die Meldung im alert_<DB>.log zu dem Fehler lautet:

WARNING: You are trying to use the MEMORY_TARGET feature. This feature requires the /dev/shm file system to be mounted for at least 1275068416 bytes. /dev/shm is either not mounted or is mounted with available space less than this size. Please fix this so that MEMORY_TARGET can work as expected. Current available is 0 and used is 0 bytes. Ensure that the mount point is /dev/shm for this directory.

Der entscheidende Punkt in der Meldung, welcher zur Lösung führt, ist, dass Oracle keinen verfügbaren Speicher erkennt ("Current available is 0 and used is 0 bytes") und dass der Mountpoint exakt /dev/shm sein muss ("Ensure that the mount point is /dev/shm for this directory").

Letztere Bedingung war auf dem Debian-System (testing) nicht erfüllt:

# df -h /dev/shm Filesystem Size Used Avail Use% Mounted on tmpfs 3.0G 0 3.0G 0% /run/shm

Als Mountpoint wird hier nicht /dev/shm angezeigt, sondern /run/shm, weil /dev/shm lediglich ein Symlink auf /run/shm ist:

# ls -l /dev/shm lrwxrwxrwx 1 root root 8 Aug 7 09:37 /dev/shm -> /run/shm

Mit diesem Setup kommt der Oracle-Kernel (11.2.0.1.0) nicht klar. Er erkennt (aus nicht weiter erforschten Gründen) die Größe des Shared-Memory-Bereichs nicht.

Der Fix besteht darin, im Oracle-Kernel alle Vorkommen von /dev/shm durch /run/shm zu ersetzen:

# cd $ORACLE_HOME/bin # cp oracle oracle.bak # sed 's|/dev/shm|/run/shm|g' oracle.bak >oracle

Danach fährt die Datenbank wieder hoch:

$ sqlplus / as sysdba SQL*Plus: Release 11.2.0.1.0 Production on Fri Aug 7 13:29:21 2020 Copyright (c) 1982, 2009, Oracle. All rights reserved. Connected to an idle instance. SQL> startup ORACLE instance started. Total System Global Area 1272213504 bytes Fixed Size 1336260 bytes Variable Size 805309500 bytes Database Buffers 452984832 bytes Redo Buffers 12582912 bytes Database mounted. Database opened.

Wer im Netz nach "debian installation" sucht, stößt auf folgendes Dokument: Debian GNU/Linux Installation Guide, welches erschlagend ist. Dabei ist die Installation von Debian sensationell einfach:

ISO-Image von Homepage herunterladen: https://www.debian.org/ (Button "Download")

Image auf ungemounteten USB-Stick kopieren (cp FILE.iso /dev/sdX)

Rechner vom USB-Stick booten

Installation durchführen

Voraussetzung hierfür ist, dass der Rechner, auf dem die Installation stattfindet, eine Verbindung ins Internet aufbauen kann (per Ethernet oder WLAN). Zusätzlicher Vorteil: Der Stick kann auch im Recovery-Fall genutzt werden (eine Netzwerkverbindung ist in dem Fall nicht nötig).

PyPerler ist ein Python-Package mit dem es möglich ist, Perl-Code unter Python zu nutzen. Es wird vom Autor nach eigener Aussage zur Zeit nicht gepflegt, funktioniert aber recht gut (Einschränkungen siehe unten). Es lassen sich damit sogar komplexe Perl-Klassen unter Python verwenden, wie z.B. Datenbank-Operationen über einen O/R-Mapper. Ich experimentiere zur Zeit damit unter Debian 10 mit Python 3.7.3 und Perl 5.28.1.

Wir setzen zunächt eine virtuelle Umgebung auf, in die wir PyPerler installieren:

$ virtualenv venv $ . venv/bin/activate

Wir holen den Sourcecode von GitHub:

$ git clone https://github.com/tkluck/pyperler.git

Wir kompilieren den Code und installieren PyPerler in die virtuelle Umgebung:

$ cd pyperler $ make $ make install

Nun können wir Perl-Code von Python aus nutzen. Ein Beispiel findet sich im README.

Die Operator-Methoden __radd__(), __rmul__() usw. fehlen in Klasse ScalarValue, so dass unter o.g. Python-Version ein Perl-Skalar ohne explizite Typwandlung zwar linksseitig mit einem Python-Objekt verknüpft werden kann, aber nicht rechtsseitig. Diese Definitionen lassen sich relativ einfach nachtragen. Als Richtschnur kann

$ make check

genutzt werden, das die Defizite aufzeigt.

Pyperler ist offenbar nicht thread-save. Eine Flask-Anwendung muss mit

$ flask run --without-threads

gestartet werden, sonst stürzt sie mit einem Segmentation Fault beim ersten Zugriff auf ein Perl-Objekt ab. Dies hat möglicherweise mit einem Fehler bei der Nutzung von Cythons Global Interpreter Lock (GIL) zu tun.

Aus Sicherheitsgründen lassen moderne Browser Ajax-Requests über Domaingrenzen hinweg nur dann zu, wenn die angefragte Resource die anfragende Domain "kennt". Ob dies der Fall ist, teilt die Resource dem Browser über den HTTP-Header Access-Control-Allow-Origin mit:

Access-Control-Allow-Origin: <origin>

Liefert die angefragte Resource diesen Header nicht oder passt <origin> nicht zur anfragenden Seite, verwirft der Browser die Response. Firefox z.B. schreibt dann die Warnung ins Console Log

Cross-Origin Request Blocked: The Same Origin Policy disallows reading the remote resource at ...

mit dem Zusatz

(Reason: CORS header 'Access-Control-Allow-Origin' missing)

wenn der Header fehlt, oder

(Reason: CORS header 'Access-Control-Allow-Origin' does not match '...')

wenn <origin> nicht passt.

Möchte die angefragte Resource Zugriffe von jeglichen Domains zulassen, liefert sie einfach

Access-Control-Allow-Origin: *

Möchte sie den Zugriff von mehreren (aber nicht allen) Domains zulassen, muss sie <origin> dynamisch zur jeweils anfragenden Seite setzen, die ihre Origin unter dem Header Origin: sendet.

Die folgenden Diagramme zeigen Zeitreihen-Plots (am Beispiel von Umweltdaten) mit "Rangeslider" auf Basis des JavaScript Plot-Frameworks Plotly.js. Die Zeitreihen behandele ich als eine Einheit, wobei ich folgende Bedienlogik realisiert habe:

In dem Diagramm, dessen Rangeslider aktiviert ist (siehe Checkbox am jeweiligen Diagramm), kann mit der linken Maustaste im Plot ein Zeitbereich ausgewählt und anschließend mit dem Rangeslider durch den Gesamtbereich gescrollt werden. Das Zoomen und Scrollen findet dabei über allen Diagrammen synchron statt. Bei Doppelklick in den Plot-Breich wird der ursprüngliche Zustand über allen Diagrammen wieder hergestellt.

Mit dem Button "Scale Y Axis" kann die Y-Achse auf den Wertebereich der sichtbaren Daten skaliert werden. Dies ist nützlich, wenn in einen Zeitbereich mit geringen Wertänderungen hineingezoomt wurde. Bei einer zweiten Betätigung wird der ursprünglche Zustand der Y-Skalierung wieder hergestellt. Bei Doppelklick in irgendein Diagramm werden alle Y-Achsen gemeinsam wieder hergestellt.

Beim Überfahren der Plots mit der Maus wird das Koordinatenpaar des nächstgelegenen Punktes angezeigt.

Im Menü "Shape" kann die Kurvendarstellung eingestellt werden. Spline: Die Messwerte werden durch eine Spline-Approximation verbunden. Linear: Die Messwerte werden durch eine gerade Linie verbunden. Marker: Die Messwerte werden nicht verbunden, sondern durch einen Punkt dargestellt. Quality: Wie Marker, nur dass in der Farbe des Punktes eine dritte Dimension (hier: die Qualität des Messwerts) kodiert ist.

Mittels des Buttons "Download as PNG" kann das Diagramm als Grafik heruntergeladen werden. Soll er Rangeslider darauf nicht erscheinen, bietet es sich an, diesen vorher wegzuschalten.

Die geplotteten Daten sind nicht Teil der HTML-Seite (!), sondern werden per Ajax-Request von einer anderen Site via Cross-Origin Resource Sharing asynchron geladen.

Sonderfall "Keine Daten": Das letzte Diagramm (GlobalRadiation) zeigt die Darstellung, wenn im gegebenen Zeitbereich keine Daten vorliegen.

| Rangeslider: | Shape: | FillArea: | | |

| Rangeslider: | Shape: | FillArea: | | |

| Rangeslider: | Shape: | FillArea: | | |

| Rangeslider: | Shape: | FillArea: | | |

| Rangeslider: | Shape: | FillArea: | | |

Ausgangslage:

In einer Datenbank mydb1 befindet sich eine Tabelle myschema1.mytable

In einer zweiten Datenbank mydb2 befindet sich eine View myschema2.myview

View myschema2.myview selektiert Tabelle myschema1.mytable

Anforderung:

Es soll ein Server-Zugang mylogin geschaffen werden, der Daten über View myschema2.myview selektieren darf, aber nicht direkt aus Tabelle myschema1.mytable.

Lösung:

Login mylogin erzeugen mit dem User-Mapping: mydb1 -> myuser1 und mydb2 -> myuser2.

User myuser1 erhält keine speziellen Rechte.

User myuser2 erhält Leserecht auf View myschema2.myview.

Den Schemata myschema1 und myschema2 den gleichen Owner geben (und damit den enthaltenen Objekten mytable und myview).

Für die Datenbanken mydb1 und mydb2 "cross-database ownership chaining" aktivieren.

SQL:

CREATE LOGIN mylogin WITH PASSWORD = 'mypassword';

CREATE DATABASE mydb1;

ALTER DATABASE mydb1 SET DB_CHAINING ON;

CREATE DATABASE mydb2;

ALTER DATABASE mydb2 SET DB_CHAINING ON;

USE mydb1;

CREATE SCHEMA myschema1;

CREATE TABLE myschema1.mytable (id INT PRIMARY KEY);

CREATE USER myuser1 FOR LOGIN mylogin;

USE mydb2;

CREATE SCHEMA myschema2;

CREATE USER myuser2 FOR LOGIN mylogin;

CREATE VIEW myschema2.myview AS SELECT * FROM mydb1.myschema1.mytable;

GRANT SELECT ON myschema2.myview TO myuser2;

Über mylogin ausgeführt:

-- erfolgreich

SELECT * FROM mydb2.myschema2.myview;

-- schlägt fehl: The SELECT permission was denied on the object 'mytable',

-- database 'mydb1', schema 'myschema1'

SELECT * FROM mydb1.myschema1.mytable;

![]()

Das potentiell komplexeste Statement in SQL ist das SELECT-Statement. Dieses wiederverwendbar zu kapseln, z.B. in einer Methode einer Klasse, kann eine Herausforderung sein. Dieses Problem wollen wir hier allgemeingültig lösen.

Hier ein Beispiel. Mit folgendem SELECT-Statement wollen wir aus dem Data Dictionary (Catalog) von PostgreSQL Informationen über die auf der Datenbank definierten Datenbank-Funktionen abfragen:

SELECT

fnc.oid AS fnc_oid

, usr.usename AS fnc_owner

, nsp.nspname AS fnc_schema

, fnc.proname AS fnc_name

, pg_get_function_identity_arguments(pro.oid) AS fnc_arguments

, pg_get_functiondef(fnc.oid) AS fnc_source

FROM

pg_proc AS fnc

JOIN pg_namespace AS nsp

ON fnc.pronamespace = nsp.oid

JOIN pg_user usr

ON fnc.proowner = usr.usesysid

Dieses relativ kurze Statement besitzt eine beachtliche Komplexität. Es erstreckt sich über drei Relationen (zwei Tabellen, eine View), deren Aufbau und Verknüpfung alles andere als offensichtlich ist. Wir wollen es so kapseln, dass wir bei Abfragen keine Details über die interne Repräsentation des Data Dictionary wissen müssen. In einem ersten Schritt haben wir den Kolumnen bereits Aliasnamen gegeben (s.o.), aus denen sich die Bedeutung der Kolumnen recht klar ergibt:

Statt oid. Objekt-Id der Funktion.

Statt usename. Name des Owners der Funktion.

Statt nspname. Name des Schemas, in dem sich die Funktion befindet.

Statt proname. Name der Funktion.

Statt pg_get_function_identity_arguments(oid). Argumentliste der Funktion als kommaseparierte Aufzählung der Datentypen. Diese Information ist bedeutsam, da eine Funktion nur durch ihre Signatur (Name plus Argumentliste) eindeutig bestimmt ist.

Statt pg_get_functiondef(oid). Quelltext der Funktion.

Über diesen Kolumnen wollen wir unsere Abfragen formulieren. Das Problem ist jedoch, dass wir die Kolumnen-Aliase nicht überall in einer Abfrage verwenden können, auch nicht in der WHERE-Klausel, die die Ergebnismenge bestimmt. Wenn wir obiges Statement um eine WHERE-Klausel ergänzen, müssen wir dort also weiterhin die internen Namen verwenden. Das wollen wir gerade nicht.

Eine mögliche Lösung ist das Anlegen einer View:

CREATE VIEW function_view AS

<obiges_statement>

Durch die View werden die internen Namen verdeckt. Abfragen der View werden allein über den Kolumnennamen des zugrundeliegenden Statements formuliert. Das ist genau das, was wir wollen. Mit der View schaffen wir allerdings eine öffentliche Schnittstelle, die wir (ohne besondere Vorkehrungen) nicht nach Belieben anlegen (Namenskonflikte) und ändern können (wir wissen nicht, wer die View sonst noch nutzt). Dies ist das Gegenteil einer Kapselung. Das Ziel einer echten Kapselung in einer Methode, und nur dort, erreichen wir mit einer View nicht.

Eine in dieser Hinsicht bessere Lösung bietet eine Inline-View, die nur innerhalb unserer Methode bekannt ist. Bei einer Inline-View betten wir das Select-Statement in die FROM-Klausel unserer Abfrage ein:

SELECT

...

FROM (

<obiges_statement>

) AS function_view

...

Diese Lösung hat jedoch den Nachteil, dass sie nicht portabel ist. Z.B. erzwingt PostgreSQL einen Namen für die Inline-View (AS function_view), Oracle jedoch nicht. Wobei ein Name im Falle von Oracle zwar vereinbart werden kann, dann aber ohne das Schlüsselwort AS.

Eine weitere Möglichkeit bietet die Einbettung in eine WITH-Klausel:

WITH function_view AS (

<obiges_statement>

)

SELECT

...

FROM

function_view

...

Diese Lösung ist portabel und separiert die konkrete Abfrage (SELECT ... FROM function_view ...) klar von dem gekapselten SELECT-Statement.

Auf dieser Grundlage können wir die Selektion wie gewünscht kapseln. Hier die Implementierung einer Methode in Perl, die so ausgelegt ist, dass die Klauseln SELECT (Namensparameter select), WHERE (Namensparameter where) und ORDER BY (Namensparameter orderBy) frei gesetzt werden können:

package PostgreSql::Catalog;

sub functionSelect {

my ($class,%clause) = @_;

# Defaults

$clause{'select'} //= ['*']; # Default für SELECT-Klausel

$clause{'from'} = ['function_view']; # FROM-Klausel ist festgelegt

# Gekapselter Statement-Rumpf

my $stmt = << ' __SQL__';

WITH function_view AS (

SELECT

fnc.oid AS fnc_oid

, usr.usename AS fnc_owner

, nsp.nspname AS fnc_schema

, fnc.proname AS fnc_name

, pg_get_function_identity_arguments(pro.oid) AS fnc_arguments

, pg_get_functiondef(fnc.oid) AS fnc_source

FROM

pg_proc AS fnc

JOIN pg_namespace AS nsp

ON fnc.pronamespace = nsp.oid

JOIN pg_user usr

ON fnc.proowner = usr.usesysid

)

__SQL__

$stmt =~ s/^ //mg;

# Erzeuge vollständiges Statement über den angegebenen Klauseln

for my $key (qw/select from where orderBy/) {

if (my $arr = $clause{$key}) {

my $clause = $key eq 'orderBy'? 'ORDER BY': uc $key;

$stmt .= sprintf "%s\n %s\n",$clause,join "\n , ",@$arr;

}

}

return $stmt;

}

Beispiel: Der Aufruf

# Ermittele alle Funktionen im Schema 'donald', deren Quelltext

# die Zeichenkette 'to_date' enthält

$sql = PostgreSql::Catalog->functionSelect(

select => [

"fnc_schema",

"fnc_name || '(' || fnc_arguments || ')' AS fnc_signature",

],

where => [

"fnc_schema = 'donald'",

"fnc_source LIKE '%to_date%'",

],

orderBy => [

1,

2

],

);

generiert das Statement

WITH function_view AS (

SELECT

fnc.oid AS fnc_oid

, usr.usename AS fnc_owner

, nsp.nspname AS fnc_schema

, fnc.proname AS fnc_name

, pg_get_function_identity_arguments(pro.oid) AS fnc_arguments

, pg_get_functiondef(fnc.oid) AS fnc_source

FROM

pg_proc AS fnc

JOIN pg_namespace AS nsp

ON fnc.pronamespace = nsp.oid

JOIN pg_user usr

ON fnc.proowner = usr.usesysid

)

SELECT

fnc_schema

, fnc_name || '(' || fnc_arguments || ')' AS fnc_signature

FROM

function_view

WHERE

fnc_schema = 'donald'

AND fnc_source LIKE '%to_date%'

ORDER BY

1

, 2

das wir gegen die Datenbank ausführen können.

Wir haben folgendes erreicht:

Wir haben das Gerüst eines komplexen Select-Statements in einer Methode gekapselt.

Wir haben eigene Kolumnennamen vereinbart, über denen wir Selektionen formulieren können. Nur diese Namen muss der Aufrufer kennen.

Wir haben eine Methode geschaffen, die eine Schnittstelle zur Erzeugung von frei formulierten Selektionen über dem gekapselten Statement bereitstellt.

![]()

Koordinaten eines (Raster-)Bildes der Breite width und der Höhe height:

![]()

Der Ursprung (0, 0) des Bild-Koordinatensystems ist oben links. Eine Bild-Koordinate bezeichnen wir mit (posX, posY), wobei posX und posY ganzzahlig sind.

Bei der Erzeugung eines XY-Plot bilden wir zwei beliebige numerische Wertebereiche minX .. maxX (X-Wertebereich) und minY .. maxY (Y-Wertebereich) auf das Bild-Koordinatensystem ab. Dem XY-Plot liegt dabei ein kartesisches Koordinatensystem zugrunde, dessen Ursprung (minX, minY) unten links ist.

Bild-Koordinate posX zu einem Wert x aus dem X-Wertebereich minX .. maxX:

Bild-Koordinate posY zu einem Wert y aus dem Y-Wertebereich minY .. maxY:

Das Python-Programm

#!/usr/bin/env python3

from selenium import webdriver

driver = webdriver.Firefox()

# eof

führt unter Debian zu dem Fehler

Traceback (most recent call last):

File "./test.py", line 5, in <module>

driver = webdriver.Firefox()

File ".../venv/lib/python3.7/site-packages/selenium/webdriver/firefox/

webdriver.py", line 174, in __init__ keep_alive=True)

File ".../venv/lib/python3.7/site-packages/selenium/webdriver/remote/

webdriver.py", line 157, in __init__ self.start_session(capabilities,

browser_profile)

File ".../venv/lib/python3.7/site-packages/selenium/webdriver/remote/

webdriver.py", line 252, in start_session response = self.execute(

Command.NEW_SESSION, parameters)

File ".../venv/lib/python3.7/site-packages/selenium/webdriver/remote/

webdriver.py", line 321, in execute self.error_handler.check_response(

response)

File ".../venv/lib/python3.7/site-packages/selenium/webdriver/remote/

errorhandler.py", line 242, in check_response raise exception_class(

message, screen, stacktrace)

selenium.common.exceptions.SessionNotCreatedException: Message: Unable

to find a matching set of capabilities

Grund hierfür ist, dass unter Debian firefox ein Shellskript ist, das das "richtige" Firefox-Executable firefox-esr indirekt aufruft. Damit kann der WebDriver von Firefox (geckodriver) nicht umgehen. Die Lösung ist, bei der Instantiierung des Firefox-Drivers den Pfad zum Firefox-Executable explizit anzugeben:

#!/usr/bin/env python3

from selenium import webdriver

driver = webdriver.Firefox(firefox_binary="/usr/bin/firefox-esr")

# eof

$ virtualenv venv $ . venv/bin/activate $ pip install selenium $ curl -L https://github.com/mozilla/geckodriver/releases/download/v0.27.0/ geckodriver-v0.27.0-linux64.tar.gz | (cd venv/bin; tar xvzf -)

(mit dem geckodriver, der zum Zeitpunkt dieses Artikels aktuell war)

Ein sehr nützliches Konzept in Emacs sind Rectangles (Rechtecke). Es gibt diverse Kommandos, um auf ihnen zu operieren. Mit C-SPC wird zunächst eine Marke auf die eine Ecke des Rechtecks gesetzt, dann wird mit dem Cursor zur gegenüberliegenden Ecke navigiert. Anschließend kann ein Kommando auf das Rechteck angewendet werden. Die Rectangle-Kommandos beginnen mit C-x r. Referenz: Rectangle Commands

Ersetze jede Zeile des Rechtecks durch eine Zeichenkette (dies kann zum Auskommentieren genutzt werden):

C-x r t <string> RET

Umkehrung. Entferne ein markiertes Rechteck (kann zum wieder Einkommentieren genutzt werden):

C-x r d

In GIMP wird beim Exportieren eines Bildes der Dateiname generell mit der Endung .png vorbelegt. Wenn man Bilder meist als JPEG (Endung .jpg) speichert, ist es lästig, ständig die Endung in .jpg ändern zu müssen. GIMP scheint keine Einstellung für ein Default Exportformat zu kennen. Hier ein Weg, wie man bei einem GIMP Executable trotzdem JPEG als Default-Exportformat festlegen kann: How to set Gimp default export to JPEG. Ich habe es ausprobiert (GIMP 2.10.8), es funktioniert.

Zusammenfassung:

$ which gimp

/usr/bin/gimp

$ ghex /usr/bin/gimp # "extension.png" durch "extension.jpg" ersetzen

In ghex Edit/Replace auswählen, dann auf der rechten Seite Such- und Ersetzung-String eintragen und per Button Replace Ersetzung durchführen.

$ cd DIR $ git init $ git add . $ git commit -m "Erstes Commit"

(Dieser Schritt kann natürlich übersprungen werden, wenn das Verzeichnis bereits unter der Kontrolle von Git steht.)

Auf GitHub einloggen und ein leeres Repository unter dem Menüpunkt + | New Repository erstellen. GitHub empfiehlt, in diesem Schritt keine README-, license- oder .gitignore-Datei generieren zu lassen, um Konflikte mit eventuell schon existierenden lokalen Dateien auszuschließen.

$ git remote add origin URL $ git push -u origin master

Hierbei ist URL die Adresse des GitHub-Repository, die nach dessen Anlegen in Schritt 2. im oberen Teil der Seite angezeigt wird,

git@github.com:USER/REPO.git # SSH-Protokoll

oder

https://github.com/USER/REPO.git # HTTPS-Protokoll

Besser ist es, SSH als Protokoll zu nutzen, da dann Public Key Athentifizierung ohne Passworteingabe genutzt werden kann.

Wurde unter 3. HTTPS als Protokoll gewählt, kann dies nachträglich geändert werden mit:

$ git remote set-url origin git@github.com:USER/REPO.git

Mein Pixel C Tablet ließ sich plötzlich (d.h. ohne ersichtlichen Grund) nicht mehr entsperren. Der Zugang lässt sich dann nur durch Zurücksetzen des Systems in den Werkszustand wiederherstellen. Dies erwies sich als unerwartet verwickelt. Hier der Ablauf:

System neu starten, dabei die Tasten "Power" und "Leiser" gedrückt halten.

Es erscheint ein Boot-Menü. Mit "Leiser/Lauter" den Menüpunkt Reboot into Android Recovery auswählen. Auswahl mit "Power" bestätigen.

Das System wird neu gestartet. Es erscheint ein umgekippter Android (s.u.) mit der Meldung "No command".

Was aussieht wie ein fataler Fehler, ist keiner. Die Tasten "Power" und "Lauter" drücken. Es erscheint ein weiteres Menü, das mit Android Recovery betitelt ist.

Mit "Leiser/Lauter" den Menüpunkt Wipe data/factory reset auswählen und mit "Power" bestätigen.

Die Daten auf dem Tablet werden gelöscht, was eine Weile dauert. Anschließend kehrt das System zum Ausgangsmenü zurück.

Nun den Menüpunkt Reboot system now auswählen. Das System startet neu. Nun kann die Neueinrichung durchgeführt werden.

Kein fataler Fehler:

Für die Ausführung von Programmen ist es oft notwendig, dass bestimmte Umgebungsvariablen gesetzt sind. Dies kann allgemeine Variablen betreffen, wie z.B. den Suchpfad PATH oder programmspezifische Variablen, wie z.B. ORACLE_HOME.

Die Frage ist, wie man eine Shell-Umgebung aufsetzt, so dass diese möglichst universell nutzbar ist, insbesondere, wenn Programme auch von außerhalb der eigenen interaktiven Sitzung, z.B. via cron, sudo oder ssh ausgeführt werden sollen.

Die Shell (bash, ksh, sh) führt bei jedem Login die nutzerspezifische Datei .profile aus. Werden in dieser Datei alle Environment-Variablen gesetzt (und exportiert), kann die Umgebung leicht in anderen Kontexten genutzt werden. Die Variablen in einer rc-Datei (.bashrc oder .kshrc) zu setzen ist verkehrt, da der Inhalt einer rc-Datei ausschließlich bei interaktiven Sitzungen ausgeführt wird und daher ausschließlich Definitionen enthalten sollte, die für eine Benutzerinteraktion mit der Shell relevant sind (Beispielsweise: Aussehen des Prompt, Aliase, Länge der History, Farben für ls(1), usw.).

Dies ist der normale Anwendungsfall. Eine Login-Shell wird gestartet und im Zuge dessen .profile ausgeführt.

Das Remote-Kommando ersetzt in diesem Fall die Login-Shell. Wir sorgen mit bash -l dafür, dass die Login-Umgebung hergestellt wird:

$ ssh USER@HOST "bash -lc 'COMMAND'"

Hier ist es wichtig, dass beim Öffnen des Terminals eine Login-Shell ausgeführt wird. Ggf. ist es nötig, hierfür eine Option in den Einstellungen zu aktivieren. In den Einstellungen des Xfce Terminals heißt die Option "Run command as login shell", ist per Default dekativert und sollte aktiviert werden.

Bei sudo sorgt die Option -i dafür, dass das Kommando an eine Login-Shell übergeben wird:

$ sudo -iu USER COMMAND

Wie bei der Ausführung eines Remote-Kommandos per ssh sorgen wir mit bash -l dafür, dass die Login-Umgebung vor Ausführung des Kommandos hergestellt wird.

* * * * * bash -lc COMMAND

Anstelle der bash nutzen wir sudo (wie oben):

* * * * * sudo -iu USER COMMAND

31.16.4.127 - - [15/Jul/2015:12:27:34 +0200] "GET /path/script.cgi?a=b HTTP/1.1" 302 583 "http://host.domain/page" "Mozilla/5.0 (X11; Linux x86_64; rv:38.0) Gecko/20100101 Firefox/38.0 Iceweasel/38.1.0"

Der Aufbau der access.log-Datei, die ein Apache HTTP-Server per Default schreibt, ist in mehrfacher Hinsicht suboptimal:

Information ist unpraktisch formatiert: Der Request-Zeitpunkt wird als [15/Jul/2015:12:27:34 +0200] (Formatelement %t) aufgezeichnet. Ein ISO-8601-ähnlicher Aufbau à la 2015-07-15 12:27:34 wäre besser lesbar und verarbeitbar. Zudem wird die Zeitzone im Normalfall nicht benötigt (da der Server ja nur in einer Zeitzone läuft, die bekannt sein sollte).

Information ist zusammengesetzt, die besser getrennt sein sollte: Der Request wird als eine Zeichenkette "GET /path/script.cgi?a=b HTTP/1.1" (Formatelement %r) aufgezeichnet. Darin sind vier Teilinformationen enthalten:

die Request-Methode (GET),

der URL-Pfad (/path/script.cgi),

der (optionale) Query-String (?a=b),

das Request-Protokoll (HTTP/1.1).

Eine Zerlegung ist nicht ganz einfach, da der Query-String optional ist. Besser wäre es, die Information in getrennten Feldern abzulegen (URL-Pfad und Query-String können zusammengelegt werden).

Interessante Information fehlt: Z.B. fehlt die Ausführungsdauer des Requests, die insbesondere bei der Performance-Optimierung von dynmisch generierten Inhalten hilfreich ist, sowie Hostname und Port, an die der Request gegangen ist, was bei einem VirtualHost-Setup von Nutzen sein kann. Auch der Content-Type der Response kann interessant sein, um Logeinträge danach filtern zu können.

Zeilen lassen sich schlecht in ihre Teilinformationen zerlegen: Eine einfache Trennung auf Whitespace geht nicht, da manche Felder Whitespace enthalten. Solche Felder sind in doppelte Anführungsstriche eingefasst. Aber nicht alle. Der Aufruf-Zeitpunkt ist in eckige Klammern eingefasst (s.o.). Fehlende Werte werden durch einen Bindstrich (-) dargestellt. Aber auch nicht immer. Für den Query-String (Formatelement %q) gilt dies nicht.

Aufgrund dieser Ungereimtheiten definiert man sich am besten ein eigenes Logfile-Format. Zum Glück ist dies mit der Apache-Direktive LogFormat leicht möglich. Ich verwende folgende Definition, mit einem senkrechten Strich als eindeutigem Feldtrenner:

LogFormat "%{%Y-%m-%d %H:%M:%S}t|%h|%>s|%L|%D|%I|%O|%{Content-Type}o|

%m|%v|%p|%U%q|%H|%{Referer}i|%{User-Agent}i" NAME

Verwendete Formatelemente (die mit + gekennzeichneten Informationen kommen im ursprünglichen Format nicht vor):

%{%Y-%m-%d %H:%M:%S}t Request-Zeitpunkt

%h .................. Client-IP oder -Name

%>s ................. finaler HTTP Status (200, ...)

%L .................. + error.log wurde geschrieben

%D .................. + Ausführungsdauer in Mikrosekunden

%I .................. + Bytes empfangen

%O .................. Bytes gesendet

%{Content-Type}o .... + Content-Type Header der Response

%m .................. Request-Methode (GET, POST, ...)

%v .................. + Hostname

%p .................. + Port

%U .................. URL-Pfad

%q .................. Query-String

%H .................. Request-Protokoll (HTTP/1.0, ...)

%{Referer}i ......... Referer Header des Requests

%{User-Agent}i ...... User-Agent Header des Requests

NAME ................ Name es Log-Formats

Ein weiteres interessantes Formatelement ist

%{COOKIE}C .......... + Wert des Cookie COOKIE

das in Anwendungen, die Cookies nutzen, nützlich sein kann. Ich füge es bei Bedarf am Ende hinzu.

Links:

2015-07-15 12:27:34|31.16.4.127|302|-|7273|400|583|text/html|GET|myhost.mydomain|80|/path/script.cgi?a=b|HTTP/1.1|http://host.domain/page|Mozilla/5.0 (X11; Linux x86_64; rv:38.0) Gecko/20100101 Firefox/38.0 Iceweasel/38.1.0

Wer Docker unter Debian installieren möchte, findet das Paket (docker-ce) nicht im Debian Repository, sondern muss es von einem Docker-Server installieren. Die entsprechende Installationsanleitung findet sich hier. Es gibt allerdings nur Pakete für die vergangenen Stable-Releases von Debian (Stretch, Jessie, Wheezy), nicht für das aktuelle Testing-Release (Buster). Das macht aber nichts, das Paket für das letzte Stable-Release (Stretch) funktioniert auch unter Buster.

Installation:

# apt-get install apt-transport-https ca-certificates curl gnupg2 software-properties-common # curl -fsSL https://download.docker.com/linux/debian/gpg | apt-key add - # apt-key fingerprint 0EBFCD88 # vi /etc/apt/sources.list # die folgende Zeile hinzufügen deb [arch=amd64] https://download.docker.com/linux/debian stretch stable # apt-get update # apt-get install docker-ce

Test:

# docker run hello-world

Verzeichnisbaum mit den Docker-Bewegungsdaten:

/var/lib/docker

Füge user USER zur Gruppe docker hinzu, damit dieser neben root ebenfalls mit Docker arbeiten kann:

# usermod -G docker USER

Container starten:

$ docker run IMAGE

Container stoppen:

$ docker stop CONTAINER

Liste der aktuell ausgeführten Container:

$ docker ps

Liste aller Container, einschließlich der beendeten:

$ docker ps -a

Lösche einen oder mehrere Container:

$ docker rm CONTAINER ...

Lösche alle unbenutzten oder unreferenzierten Images, Container, Volumes und Networks:

$ docker system prune -a

Kommando im Container ausführen:

$ docker exec CONTAINER COMMAND ARG ...

Z.B.

$ docker run debian -d sleep 120 # -d = detach 06f0ee0e2256c5d531f8134f1bbb8f91b7189483c4ab21c4fb7807384420b1bf $ docker exec 06f0ee0e2256 cat /etc/hosts 127.0.0.1 localhost ::1 localhost ip6-localhost ip6-loopback fe00::0 ip6-localnet ff00::0 ip6-mcastprefix ff02::1 ip6-allnodes ff02::2 ip6-allrouters 172.17.0.2 06f0ee0e2256

Stdin und stdout mit dem Container verbinden:

$ docker run -it IMAGE # -i = stdin, -t = stdout

Einen internen Port auf einen externen Port abbilden:

$ docker run -p PORT_EXTERN:PORT_INTERN IMAGE PORT_INTERN: Port innerhalb des Containers PORT_EXTERN: Port auf dem Docker-Host

Ein internes Verzeichnis auf ein externes Verzeichnis abbilden:

$ docker run -v DIR_EXTERN:DIR_INTERN IMAGE DIR_EXTERN: Verzeichnis auf dem Docker-Host DIR_INTERN: Verzeichnis innerhalb des Containers

Environement-Variablen setzen:

$docker run -e NAME=VALUE IMAGE

(die definierten Enviroment-Variablen: docker inspect IMAGE)

Logs auf stdout ausgeben:

$ docker logs CONTAINER

Image herunterladen:

$ docker pull IMAGE

Liste der lokal vorrätigen Images:

$ docker image ls

Lösche ein oder mehrere Images:

$ docker rmi IMAGE ...

Image-Konfiguration ansehen:

$ docker inspect IMAGE

Image in TAR speichern:

$ docker image save IMAGE >FILE.tar

Image in Dateisystem entpacken (mit dem Zusatzprogramm undocker):

$ docker image save IMAGE | undocker -o DIR

Image im globalen Repository (Docker Hub) suchen:

$ docker search TERM

Eigenes Image erstellen:

$ mkdir my-app $ cd my-app $ vi Dockerfile ... $ docker build -t my-app .

Beispiel:

FROM debian RUN apt-get update RUN apt-get -y install python3 RUN apt-get -y install python3-pip RUN pip3 install flask RUN pip3 install flask-mysql COPY . /opt/www ENTRYPOINT FLASK_APP=/opt/www/app.py flask run --host=0.0.0.0

Image erzeugen:

docker build . -t ACCOUNT/NAME

Beispiel:

$ docker build . -t s31tz/webapp $ docker run -p 5000:5000 s31tz/webapp

Erzeugungshistorie anzeigen:

$ docker history IMAGE

Alle Images entfernen, die von keinem Container genutzt werden:

$ docker image prune -a

Lokales Netz (Class B) erzeugen:

$ docker network create NAME

Liste der Netze:

$ docker network ls

Lösche ein oder mehrere Netze:

$ docker network rm

Globales Repository von Docker-Images (Account ist kostenlos):

Doku zu den offiziellen Docker-Images:

Wer Jenkins unter Debian installieren möchte, findet das Paket (jenkins) nicht im Debian Repository, sondern muss es von einem Jenkins-Server installieren.

# curl -fsSL http://pkg.jenkins-ci.org/debian/jenkins-ci.org.key | apt-key add - # echo deb http://pkg.jenkins-ci.org/debian binary/ >/etc/apt/sources.list.d/jenkins.list # apt-get update # apt-get install jenkins

Anschließend mit dem Browser auf http://localhost:8080 gehen, Jenkins mit Administrator-Passwort freischalten, mit "Install suggested plugins" den Standardsatz an Plugins installieren und die Installation mit der Einrichtung des ersten Administrator-Accounts abschließen.

Jenkins starten (findet bei der Installation automatisch statt):

# /etc/init.d/jenkins start

Jenkins stoppen:

# /etc/init.d/jenkins stop

Jenkins Homeverzeichnis (~jenkins):

/var/lib/jenkins

Jenkins läuft per Default auf Port 8080. Ein anderer Port kann in /etc/default/jenkins konfiguriert werden.

Wer seinen Browser auf Deutsch eingestellt hat, erhält bei Jenkins eine deutschsprachige Bedienoberfläche. Wer, wie ich, eine englischsprachige Bedienoberfläche bevorzugt, aber nicht die Browsersprache umstellen möchte, kann dies mit dem Plugin "Locale" erreichen:

Jenkins verwalten / Plugins verwalten -> Plugin "Locale" installieren

Jenkins verwalten / System konfigurieren -> Default Language: English + Ignore browser preference and force this language to all users

Anschließend ist die Bedienoberfläche auf englisch.

Damit Jenkins auf ein Git-Repository zugreifen kann, sind zwei Angaben nötig: 1. Der URL des Git-Repository, 2. Die Credentials für den Repository-Zugriff. Zum Beispiel:

Project Repository: ssh://fs2@localhost/~/try/jenkins/example01 Domain: Global credentials (unresticted) Kind: SSH Userkey with private key Scope: Global (Jenkins, nodes, items, etc.) Username: fs2 Private Key: from the jenkins master ~/.ssh

Schlüsselpaar für jenkins erzeugen und zu den authorized_keys des Repostitory-Owners fs2 hinzufügen:

# cd ~jenkins/.ssh # ssh-keygen -t rsa # chown jenkins.jenkins * # cat id_rsa.pub >>~fs2/.ssh/authorized_keys

Siehe auch: How to Setup Git Repository and Credentials for Jenkins Jobs

Damit Jenkins Docker-Operationen ausführen kann, muss der der Benutzer jenkins zur Gruppe docker hinzugefügt werden:

# usermod -G docker jenkins # /etc/init.d/jenkins restart

Wer sich als Admin mit Confluence befassen oder gegen die REST-Schnittstelle programmieren möchte oder einfach eine temporäre Testinstanz braucht, ohne selbst über eine Confluence-Instanz zu verfügen, kann sich beim Hersteller eine kostenlose Cloud-Instanz zulegen:

Confluence Cloud Server (free trial)

Nach dem Ausfüllen des Formulars und der Bestätigung einer Email steht einem eine Confluence Cloud-Instanz eine Woche kostenlos zur Verfügung. Danach kann man die Instanz kostenpflichtig weiter führen oder löschen.

CPAN::Mini installieren

$ cpanm CPAN::Mini

Konfigurationsdatei erstellen

$ vi ~/.minicpanrc local: MINICPAN remote: MIRROR exact_mirror: 1

Offline-Mirror aufbauen bzw. aktualisieren

$ minicpan

Ein Modul aus dem Offline-Mirror standardmäßig installieren

$ cpanm --mirror MINICPAN --mirror-only MODULE

oder "self contained" in ein bestimmtes Verzeichnis

$ cpanm --mirror MINICPAN --mirror-only -L DIR MODULE

Hierbei ist:

Der Pfad des Verzeichnisses, in dem wir unseren CPAN Offline-Mirror speichern, z.B. der Pfad eines gemounteten USB-Sticks.

Der URL des CPAN-Mirrors, aus dem wir unseren Offline-Mirror befüllen (Liste der verfügbaren Sites siehe http://www.cpan.org/SITES.html).

Ein Perl-Modul, das wir aus unserem Offline-Mirror installieren.

Ein lokales Verzeichnis, in das wir Perl-Module installieren.

MP3-Dateien können mit dem concat-Protokoll konkateniert werden, die Bitraten müssen nicht übereinstimmen:

$ ffmpeg -i "concat:INPUT1.mp3|INPUT2.mp3|..." -c copy OUTPUT.mp3

Über die Plugin-Schnittstelle kann Mojolicious oder eine Mojolicious-Applikation um jede denkbare Funktionalität erweitert werden. Die Plugin-Schnittstelle ist sehr einfach gehalten. Denn sie gibt nur vor, wie eine Funktionalität zum System hinzugefügt wird, nicht jedoch, um welche Art von Funktionalität es sich handelt.

Die Implementierung eines Mojolicious-Plugin erfolgt in zwei Schritten:

Durch Ableitung von Mojolicious::Plugin wird eine Subklasse - die Plugin-Klasse - gebildet.

In der Plugin-Klasse wird die Methode register() implementiert.

In der Dokumentation zur Basisklasse Mojolicious::Plugin wird die Implementierung so beschrieben:

package Mojolicious::Plugin::MyPlugin;

use Mojo::Base 'Mojolicious::Plugin';

sub register {

my ($self, $app, $conf) = @_;

# Magic here! :)

}

Der Aufwand der Plugin-Implementierung besteht natürlich darin, den mit

# Magic here! :)

bezeichneten Teil mit Leben zu füllen.

Ist das Plugin implementiert, wird es durch einen einzigen Aufruf zur Applikation hinzugefügt:

$app->plugin(MyPlugin => \%config);

Der analoge Aufruf unter Mojolicious::Lite:

plugin MyPlugin => \%config;

Hierbei ist %config ein Hash mit Schlüssel/Wert-Paaren - typischerweise als Hash-Literal angegeben - durch den das Plugin konfiguriert wird. Ist keine Konfigurierung des Plugin nötig, kann das Argument weggelassen werden.

Als einfaches Beispiel implementieren wir ein Plugin Hello, das bei jedem hereinkommenden Request die Zeichenkette 'Hello' und die IP-Adresse des Aufrufers ins Log ausgibt. Dies erreichen wir, indem wir in der Methode register() einen before_routes-Handler aufsetzen, der genau dies tut.

package Mojolicious::Plugin::Hello;

Mojo::Base 'Mojolicious::Plugin';

sub register {

my ($self, $app, $conf) = @_;

$app->hook(before_routes=>sub {

my $c = shift;

$c->app->log->debug('Hello '.$c->tx->remote_address);

});

return;

}

Das Plugin wird durch

$app->plugin('Hello');

oder im Falle von Mojolicious::Lite durch

plugin 'Hello';

in der Applikation aktiviert. Eine Konfiguration ist bei den Aufrufen nicht angegeben, da das Plugin keine Konfigurierungsmöglichkeit vorsieht.

Konfigurationsprogramm des Druckers unter seiner IP im lokalen Netz, z.B. http://192.168.178.24/

HPLIB (HP Linux Imaging and Printing) installieren:

# apt-get install hplip hplib-gui hplib-doc

Lokale Dokumentation: file:///usr/share/doc/hplip-doc/index.html

Überprüfung der Abhängigkeiten, Permissions etc. von HPLIP und Nachinstallation von fehlenden Paketen (dies ist in diesem speziellen Fall durch die Installation per apt-get - was ungewöhnlich ist - nicht sicher gestellt):

$ hp-check

Verfügbarkeit des Druckers via USB, Ethernet, WLAN prüfen:

$ hp-probe

Treiber des Druckers herunterladen und Drucker und Fax rudimentär einrichten:

$ hp-setup -i

HP Device Manger:

$ hp-toolbox

Der Drucker unter CUPS: http://localhost:631

Drucker zum Default-Drucker machen (für lpr/lpq):

$ lpoptions -d PRINTER

Mit dem Programm hp-scan kann vom Flachbett oder über den Dokumenteneinzug gescannt und das Ergebnis lokal gespeichert werden, ohne mit einem USB-Stick hantieren zu müssen. Außerdem hat das Programm diverse Optionen, mit denen auf das Scan-Ergebnis Einfluss genommen werden kann ($ man hp-scan).

Beispiel: Scanne alle A4-Seiten (--size=a4), die auf der automatischen Dokumentenzufuhr (--adf) eingelegt sind in Farbe (--mode=color) mit 150 DPI (--resolution=150) und füge sie zu einem PDF-Dokument (Dateiendung .pdf) zusammen:

$ hp-scan --adf --size=a4 --mode=color --resolution=150 --file=FILE.pdf

Im Falle von PDF sind die Auflösungen 75, 100, 150, 200, 300 DPI möglich, bei JPG oder PNG bis zu 1200 DPI.

Header mit beliebigem Inhalt:

| 1 | <div id="header"> |

| 2 | CONTENT |

| 3 | </div> |

Header am Seitenanfang fixieren:

| 1 | #header { |

| 2 | position: fixed; |

| 3 | top: 0; |

| 4 | width: 100%; |

| 5 | z-index: 1; |

| 6 | background-color: COLOR; |

| 7 | } |

Am Seitenanfang Platz für den fixierten Header reservieren:

| 1 | $(function () { |

| 2 | $('body').css('margin-top',$('#header').outerHeight()); |

| 3 | }); |

Demo:

Die jQuery UI Widgets Tabs und Accordion könnten - bis auf die Ausrichtung ihrer Reiter (Tabs horizontal, Accordion vertikal) - identisch sein. Sind sie aber nicht. Während das Tabs-Widget das Laden von Inhalten per Ajax direkt unterstützt, ist dies beim Accordion-Widget nicht vorgesehen. Es ist jedoch möglich, dies durch einen beforeActivate Event-Handler und bestimmte Einstellungen zu realisieren.

<div id="ID">

<h3><a href="URL">TITLE</a></h3>

<div></div>

...

</div>

ID ist die DOM-Id des Accordion. Der TITLE des Reiters wird in einen a-Tag eingefasst, dessen href-Attribut den URL definiert, von dem wir den Inhalt des Accordion-Panel per Ajax abrufen. Der div-Container für den Panel-Content ist leer, dieser wird per Ajax gefüllt.

$('#ID').accordion({

beforeActivate: function (event,ui) {

var url = ui.newHeader.find('a').attr('href');

if (url)

ui.newPanel.load(url);

},

active: false,

collapsible: true,

heightStyle: 'content'

});

Das Laden des Panel-Inhalts per Ajax realisiert der beforeActivate-Handler, den wir bei der Instanziierung des Accordion-Widget definieren (Zeilen 2-6). Wir nutzen den beforeActivate-Handler und nicht den activate-Handler, da er vor dem Öffnen des Reiters gerufen wird. D.h. zum Zeitpunkt des Öffnens ist der Inhalt bereits geladen, was einen flüssigen Ablauf ergibt.

Die Setzungen

active: false collapsible: true

bewirken in dieser Kombination, dass zunächst alle Reiter geschlossen bleiben, denn das initiale Öffnen feuert nicht die beforeActivate- und activate-Events. Das initiale Öffnen realisieren wir durch das Auslösen eines Click-Event nach der Accordion-Instanziierung (s.u.).

Die Setzung

heightStyle: 'content'

bewirkt, dass die Höhe des Panel automatisch an den geladenen Inhalt angepasst wird. Dies ist wichtig, da der Inhalt vorab nicht bekannt ist.

$('#ID a:first').trigger('click');

Den ersten Accordion-Reiter öffnen wir durch das Auslösen eines Click-Event, so als hätte der Anwender auf den ersten Reiter geklickt. Auf diese Weise ist sichergestellt, dass der beforeActivate-Handler gerufen und damit der Inhalt geladen wird.

Links:

Mit der Class Option hover kann beim jQuery Plug-In DataTables eingestellt werden, dass die Tabellen-Zeile unter der Maus hervorgehoben wird. Leider ist die Hervorhebung so schwach, dass sie in Kombination mit Class Option stripe auf den dunkleren Zeilen kaum sichtbar ist.

Hier der CSS-Code, mit dem sich die Hover-Farbe ändern lässt:

#ID.dataTable.hover tbody tr:hover, #ID.dataTable.display tbody tr:hover { background-color: COLOR; }

Hierbei ist ID die DOM-Id der Tabelle und COLOR die gewünschte Farbe. Die Hover-Farbe ist per Default auf das sehr helle Grau #f6f6f6 eingestellt. Wählt man z.B. das dunklere #e8e8e8, ist die Hervorhebung deutlich erkennbar.

Soll die Hover-Farbe für alle DataTables gelten:

table.dataTable.hover tbody tr:hover, table.dataTable.display tbody tr:hover { background-color: COLOR; }

Ein leistungsfähiges jQuery Plug-In für Tabellen ist DataTables. Es kann in vielfältiger Weise konfiguriert werden. Einige Anpassungen im Zusammenhang mit dem Filter-Suchfeld sind allerdings schlecht dokumentiert. Das Filter-Suchfeld ist per Default mit dem Label-Text "Search:" beschriftet und befindet sich rechts über der Tabelle. Hier eine kurze Beschreibung, wie dieses Setup geändert werden kann. Im folgenden Code stehen ID, LABEL und WIDTH für die frei wählbaren Angaben DOM-Id der Tabelle, Label-Text und CSS-Breite.

Label-Text setzen (JS):

$('#ID').DataTable({

...

'language': {

'search': 'LABEL'

}

});

Suchfeld links positionieren (CSS):

#ID_filter {

float: left;

}

Suchfeld mittig positionieren (CSS):

#ID_filter {

width: 100%;

text-align: center;

}

Größe des Suchfelds ändern (CSS):

#ID_filter input[type="search"] {

width: WIDTH;

}

Eigenes Suchfeld definieren:

<input type="text" id="searchField" ...>

$('#searchField').on('keyup',function () {

tab.search(this.value).draw();

});

Das von DataTables erzeugte Suchfeld unterdrücken:

$('#ID').DataTable({

dom: 't', // nur die Tabelle selbst, ohne Suchfeld etc.

...

});

Gegeben ein Perl-Projekt myproject mit einem eigenen Projektverzeichnis PREFIX/myproject und einer Unix-typischen Unterverzeichnisstruktur mit den Verzeichnissen bin, lib usw.

PREFIX/myproject/bin/myprogram

lib/perl5/MyClass.pm

...

PREFIX ist ein beliebiger Verzeichnis-Pfad. Im Unterverzeichnis bin sind die Programme des Projektes installiert (hier ein Programm myprogram) und in Unterverzeichnis lib/perl5 die Module des Projektes (hier ein Modul MyClass.pm).

Wir wollen das Programm myprogram nun außerhalb des Projektbaums verfügbar machen, z.B. damit es über einen allgemeinen Suchpfad aufrufbar ist, oder - falls es ein CGI-Programm ist - um es in eine Web-Verzeichnisstruktur einzufügen, ohne dass wir einen ScripAlias definieren können oder wollen.

Das Problem: Außerhalb des Projektbaums installiert verliert das Programm den Bezug zum Projektverzeichnis und kann die anderen Verzeichnisse des Baums, wie z.B. das Modulverzeichnis lib/perl5 nicht ohne Weiteres adressieren. Man könnte den Pfad zum Projektverzeichnis auf einer Environment-Variablen definieren, aber das ist umständlich.

Ein eleganterer Weg ist, das Programm per Symlink außerhalb des Projektbaums zu installieren und den realen Installationspfad des Programms mittels der Variable $RealBin des (Core-)Moduls FindBin zu ermitteln.

$ ln -s PREFIX/myproject/bin/myprogram /usr/local/bin/myprogram

Am Anfang von myprogram, vor dem Laden des projektspezifischen Moduls MyClass, fügen wir die beiden Zeilen ein:

use FindBin qw/$RealBin/; use lib "$RealBin/../lib/perl5"; use MyClass;

Der Pfad $RealBin ist das Verzeichnis, in dem das aufgerufene Programm sich befindet, und zwar nach Auflösung aller Symlinks. D.h. der Pfad ist stets

PREFIX/myproject/bin

auch wenn das Programm über den Pfad /usr/local/bin/myprogram aufgerufen wird.

Der reinen Datenbank-Lehre nach ist es strikt verboten mehrere Werte auf einem Attribut zu speichern. Sowas kommt in der Realität trotzdem vor, sogar bei Fremdschlüssel-Attributen. D.h. das Fremdschlüssel-Attribut referenziert in dem Fall nicht nur eine, sondern mehrere Zeilen. Die gute Nachricht ist, dass MySQL es erlaubt, für so ein - ansich unterlaubtes - Design mithilfe der Funktion find_in_set() eine Join-Condition zu formulieren.

Gegeben zwei Tabellen TableA und TableB, wobei Attribut TableB.tablea_id auf mehrere Zeilen in TableA verweist.

TableA TableB id id tablea_id -- -- --------- 1 1 2,3 2 2 3 3 3 1,2,3,4 4 4 NULL

Wäre TableB.tablea_id ein normales Fremdschlüssel-Attribut mit einem Wert sähe die Join-Condition so aus:

TableA.id = TableB.tablea_id

Diese Bedingung ist hier nicht anwendbar, da eine Identität (=) zwischen TableA.id und TableB.tablea_id nur manchmal gegeben ist.

Die Selektion

SELECT

b.id b_id

, a.id a_id

FROM

TableA a

INNER JOIN TableB b

ON a.id = b.tablea_id

ORDER BY

b.id

, a.id

liefert ein falsches Resultat

+------+------+ b_id | a_id | +------+------+ | 1 | 2 | zweifelhaft | 2 | 3 | erwartet | 3 | 1 | zweifelhaft +------+------+

Da MySQL bei numerischen Identitäts-Vergleichen eine laxe Auffassung hat und gegen den numerischen Anfang einer Zeichenkette vergleicht, auch wenn die Zeichenkette insgesamt keine Zahl darstellt, ist die Ergebnismenge zusätzlich zweifelhaft. Statt der erwarten einen Zeile werden drei Zeilen geliefert.

MySQL besitzt jedoch eine Funktion find_in_set(), mit deren Hilfe eine Join-Condition formuliert werden kann, die die mehrwertigen Verweise korrekt auflöst:

FIND_IN_SET(TableA.id, TableB.tablea_id) > 0

Die Selektion

SELECT

b.id b_id

, a.id a_id

FROM

TableA a

INNER JOIN TableB b

ON FIND_IN_SET(a.id, b.tablea_id) > 0

ORDER BY

b.id

, a.id

liefert das korrekte Resultat

+------+------+ b_id | a_id | +------+------+ | 1 | 2 | | 1 | 3 | | 2 | 3 | | 3 | 1 | | 3 | 2 | | 3 | 3 | | 3 | 4 | +------+------+

TeamViewer kann nicht per apt-get installiert werden. Das Debian-Paket muss stattdessen von der Download-Seite des Herstellers heruntergeladen und manuell installiert werden. Zu beachten ist, dass auf neueren 64bit-Debian-Systemen (mit Multiarch-Support) das i386-Paket installiert werden muss (siehe "Hinweise zur Installation" auf der Download-Seite).

Debian-Paket von Download-Seite herunterladen. Der Dateiname lautet aktuell teamviewer_11.0.53191_i386.deb.

# dpkg --add-architecture i386 # apt-get update # gdebi teamviewer_11.0.53191_i386.deb ... Do you want to install the software package? [y/N]:y ...

Sollte gdebi nicht installiert sein, kann dies mit

# apt-get install gdebi

nachgeholt werden. Das Programm installiert lokal vorliegende Debian-Pakete und löst automatisch alle Abhängigkeiten auf (was dpkg -i nicht macht).

Es kommt vor, dass der TeamViewer-Client keine Connection herstellen kann und die Meldung anzeigt

Not ready. Check your connection.

Dies lässt sich u.U. durch einen Neustart des Dämons beheben

# teamviewer daemon restart

Entferne POD-Abschnitte aus Perl-Quelltext:

$src =~ s/^=[a-z].*?^=cut\n*//msg;

Entferne ganzzeilige Kommentare aus Perl-Quelltext:

$src =~ s/^[\t ]*#.*\n+//mg;

Entferne teilzeilige Kommentare aus Perl-Quelltext:

$src =~ s/[\t ]+# .*//g;

Diese Operationen sind nützlich, wenn man einen Perl-Quelltext ohne Dokumentation und Kommentare ausliefern möchte, oder wenn man entscheiden möchte, ob eine Quelltextänderung getestet werden muss. Letzteres ist ratsam, wenn Änderungen in dem Teil des Quelltextes existieren, der übrig bleibt, wenn man die Dokumentation und die Kommentare entfernt.

Als teilzeiliger Kommentar wird die Abfolge WHITESPACE-HASH-SPACE-TEXT akzeptiert. Ein teilzeiliger Kommentar muss entsprechend verfasst sein, sonst wird er nicht entfernt. Diese Einschränkung hat den Zweck, Fehl-Erkennungen zu vermeiden, denn

$src =~ s/#.*//g;

wäre gefährlich, da dieser Regex nach jedem HASH abschneidet. Siehe auch folgende Warnung.

Warnung: Ohne echtes Parsing gemäß der Grammatik einer Sprache sind absolut sichere Operationen auf einem Quelltext nicht möglich - insbesondere bei Perl, das eine sehr facettenreiche Syntax hat. Obige Pattern können in besonderen Fällen den Inhalt von String-Literalen matchen. Im Einzelfall kann so eine Fehl-Erkennung durch Änderung des Literals - z.B. durch Einstreuen von Backslashes - verhindert werden.

Anforderung: Ein Hash-Objekt besitzt ein Attribut theAttribute, das von einer gleichnamigen Attributmethode gekapselt wird. Das Attribut erhält bei der Objekt-Instanziierung keinen Wert. Der Wert wird stattdessen beim ersten Zugriff berechnet. Alle weiteren Zugriffe liefern den berechneten Wert.

Ein naheliegender Ansatz, dies in Perl zu implementieren, ist:

| 1 | sub theAttribute { |

| 2 | my $self = shift; |

| 3 | |

| 4 | if (!defined $self->{'theAttribute'}) { |

| 5 | ... |

| 6 | $self->{'theAttribute'} = $val; |

| 7 | } |

| 8 | |

| 9 | return $self->{'theAttribute'}; |

| 10 | } |

Hierbei ist $val der in Abschnitt ... berechnete Attributwert (der auf dem Attribut gecached wird).

Diese Lösung ist relativ hässlich, da der Ausdruck

$self->{'theAttribute'}

gleich drei Mal auftaucht.

Zum Glück lässt sich die Sache auch eleganter formulieren:

| 1 | sub theAttribute { |

| 2 | my $self = shift; |

| 3 | |

| 4 | return $self->{'theAttribute'} //= do { |

| 5 | ... |

| 6 | $val; |

| 7 | }; |

| 8 | } |

Erklärung: Ist der Wert von theAttribute definiert, wird er unmittelbar geliefert. Ist er nicht definiert, wird der do-Block ausgeführt. Dessen Wert wird erst an das Attribut zugewiesen (=) und dann von der Methode geliefert (return). Den Defined-Or-Operator // gibt es seit Perl 5.10.

Ist die Objektstruktur komplexer als ein Hash, lässt sich die Semantik von

$self->{$key} //= do { ... };

auch als Objektmethode mit einer anonymen Subroutine als Parameter realisieren:

| 1 | sub memoize { |

| 2 | my ($self,$key,$sub) = @_; |

| 3 | |

| 4 | my $val = $self->get($key); |

| 5 | if (!defined $val) { |

| 6 | $val = $self->$sub($key); |

| 7 | $self->set($key=>$val); |

| 8 | } |

| 9 | |

| 10 | return $val; |

| 11 | } |

Hierbei sind get() und set() die Methoden zum Abfragen und Setzen des Attributwerts. Natürlich kann der Zugriff auf das Attribut - in Abhängigkeit von der Klasse - auch anders realisert sein.

Angewendet auf obiges Beispiel:

| 1 | sub theAttribute { |

| 2 | my $self = shift; |

| 3 | |

| 4 | return $self->memoize('theAttribute',sub { |

| 5 | ... |

| 6 | $val; |

| 7 | }); |

| 8 | } |

Finde innerhalb des Dateibaums DIR alle Vorkommen des Wortmusters REGEX und gib die Wortliste sortiert aus (GNU grep):

$ grep -oPhr REGEX DIR | sort | uniq

Soll die Menge der Dateien näher eingeschränkt werden, lässt sich dies durch ein vorgeschaltetes find erreichen (Option -r bei grep entfällt dann):

$ find DIR -type f -print0 | xargs -0 grep -oPh REGEX | sort | uniq

Finde in Dateibaum app mit Perl-Quelltexten die Namen aller verwendeten Klassen, die mit "R1::" beginnen:

$ grep -oPhr 'R1::[:\w]+' app | sort | uniq R1::AppHome R1::Array R1::CheckValue R1::ClassLoader R1::Config R1::Dbms::Database ...

Manchmal möchte man für ein Perl-Programm wissen, woher genau der Perl-Interpreter die Module lädt. Aus dem laufenden Programm heraus lässt sich dies mit folgender Zeile bestimmen:

say join "\n",sort values %INC;

Dasselbe mit print:

print join("\n",sort values %INC),"\n";

Die Anweisung gibt die Liste der Pfade aller geladenen Module sortiert aus.

Dasselbe auf der Kommandozeile, falls einen interessiert, welche Module ein bestimmtes Modul <MODULE> lädt:

$ perl -M5.010 -M<MODULE> -e 'say join "\n",sort values %INC'

Mitunter möchte man wissen, ob ein bestimmter Host erreichbar ist, z.B. vor Beginn von Regressionstests gegen Services des Hosts. Diese Prüfung kann in Perl mittels des Core-Moduls Net::Ping durchgeführt werden.

use Net::Ping;

my $p = Net::Ping->new;

my $isAlive = $p->ping($host);

$p->close;

if ($isAlive) {

print "Host $host ist erreichbar\n";

}

Per Default versucht die Klasse via TCP eine Verbindung zum echo-Port aufzubauen. Für andere Möglichkeiten (Test per UDP, ICMP, ...) siehe Doku.

Für die Skalierung von Grafik-Elementen, die in Ground Overlays für Google Earth platziert werden sollten, stand ich vor der Notwendigkeit, Abstände auf der Erdoberfläche berechnen zu müssen. Die folgende Gleichung hat mir dies ermöglicht.

Entfernung (in km) zwischen zwei Punkten auf der Erdoberfläche:

![]()

Die Gleichung liefert die Länge des Großkeisbogens zwischen zwei Punkten (lat1, lon1) und (lat2, lon2) auf einer Kugel mit einem Radius von 6371 Kilometern. Da die Erde keine perfekte Kugel ist (6371 km ist der mittlere Radius), stellt die Berechnung eine Näherung dar, die vor allem für größere Distanzen geeignet ist. Möchte man die Seemeile (= 1,852 km) als fundamentales Abstandsmaß für das Geosystem zugrundelegen (der geliefert Wert ist nach wie vor km, aber der Erdumfang wird als das 60*360-fache einer Seemeile definiert), ersetzt man 6371 durch

![]()

Die Formel geht davon aus, dass die trigonometrischen Funktionen acos(), sin(), cos() im Bogenmaß (rad) rechnen, was für Programmiersprachen typischerweise der Fall ist. Liegen lat1, lon1, lat2, lon2 in Grad vor, was bei Geopositionen üblich ist, müssen diese vor der Einsetzung ins Bogenmaß umgerechnet, also mit Pi/180 multipliziert werden.

![]()

Begründung und Herleitung der Formel: Blog Martin Kompf - Entfernungsberechnung

Mitunter soll das erste Element eines HTML-Konstrukts per CSS speziell gestaltet werden, z.B. was dessen Außenabstände angeht. Diese Anforderung gibt es in zwei Ausprägungen:

Das zu behandelnde Element ist das erste Element, das dem Bezugselement folgt.

Das zu behandelnde Element ist das erste Element, das dem Bezugselement untergeordnet ist.

Diese beiden Element-Anordnungen erfordern unterschiedliche CSS-Selektoren.

<X>...</X>

<Y>

...

</Y>

...

Der CSS-Selektor lautet:

X + * {

...

}

Bezugselement ist X. Der Selektor + selektiert das unmittelbar folgende Element. Der Universelle Selektor * füllt hier syntaktisch die zweite Argumentposition des Selektors und nimmt keine weitere Einschränkung vor.

Beispiel: Jedes erste Element nach einer <h1>-Überschrift soll einen oberen Außenabstand von 0.5em erhalten:

h1 + * {

margin-top: 0.5em;

}

<X>

<Y>

...

</Y>

</X>

Der CSS-Selektor lautet:

X > *:first-child {

...

}

Bezugselement ist X. Der Selektor > selektiert alle Elemente, die dem Bezugselement direkt untergeordnet sind. Die Pseudoklasse *:first-child schränkt diese Menge auf das erste Kindelement ein (der Stern kann auch weggelassen werden).

Beispiel: Jedes erste Unterelement <Y> eines <dd>-Definitionsabschnitts soll keinen oberen Außenabstand besitzen, sondern direkt an den Definitionsterminus <dt> anschließen:

HTML:

<dl>

<dt>...</dt>

<dd>

<Y>

...

</Y>

</dd>

...

</dl>

CSS:

dd > *:first-child {

margin-top: 0;

}

Eine Datei per HTTP-Response mit Dateinamens-Vorschlag FILE_NAME vom Server zum Client zu transferieren geht so:

Per Location Redirection

Location: URL Content-Disposition: attachment; filename="FILE_NAME"

Per direkter Übertragung

Content-Type: TYPE/SUBTYPE Content-Disposition: attachment; filename="FILE_NAME" FILE_CONTENT

Die direkte Übertragung hat den Vorteil, dass die Datei nach dem Download serverseitig sofort gelöscht werden kann, falls sie nicht mehr gebraucht wird. Das ist bei einer Location Redirection nicht möglich, da der Client sie asynchron abruft.

Idealerweise sollte ein Programm sowohl mit ISO-8859-1 als auch mit UTF-8 Input-Dateien umgehen können, und zwar am besten so, dass das Encoding nicht explizit angegeben werden muss.

Lässt sich dies realisieren?

Ja, indem das Programm sich den Inhalt der Datei "ansieht", entscheidet, welches Encoding vorliegt und den Text entsprechend dekodiert.

Im Falle von Perl kann hierfür das Modul Encode::Guess genutzt werden. Es ist Teil des Perl-Core und damit in jeder Perl-Installation enthalten. Es wird mit

use Encode::Guess;

geladen.

Wir nutzen die objektorientierte Schnittstelle des Moduls. Theoretisch sollte folgender Sechszeiler die Aufgabe erledigen:

Encode::Guess->set_suspects('iso-8859-1');

my $dec = Encode::Guess->guess($text);

if (!ref $dec) {

die "ERROR: $dec\n";

}

$text = $dec->decode($text);

Erläuterung:

Wir definieren iso-8859-1 als Encoding, das zusätzlich zu den Default-Encodings ascii, utf8, UTF-16/32 mit BOM, geprüft werden soll.

Der Inhalt der Datei steht auf der Variable $text (das Einlesen hat vorher stattgefunden und ist hier nicht wiedergegeben). Die Methode guess() versucht das Encoding zu ermitteln und liefert im Erfolgsfall ein passendes Decoder-Objekt. Im Fehlerfall liefert die Methode eine Fehlermeldung (also eine Zeichenkette).

Fehlerbehandlung. Falls wir eine Fehlermeldung erhalten, brechen wir mit einer Exception ab. Zwei mögliche Fehlerfälle sind:

Der Text entspricht keinem der geprüften Encodings.

Mehr als eines der Encodings kommt infrage.

Es wurde ein Decoder-Objekt geliefert, also ein Encoding eindeutig erkannt. Wir dekodieren den Text mit dem Decoder-Objekt.

Leider funktioniert diese Implementierung nicht!

Denn wir stellen folgendes fest:

Ist die Datei ISO-8859-1 kodiert, gelingt das Dekodieren.

Ist die Datei UTF-8 kodiert, bricht der Code mit der Fehlermeldung

ERROR: utf8 or iso-8859-1

ab, d.h. der Methode guess() war es nicht möglich, das Encoding eindeutig zu bestimmen.

Woran liegt das?

Die Ursache ist, dass jede UTF-8-Datei formal auch eine ISO-8859-1-Datei ist. Denn jede Datei ist formal eine ISO-8859-1-Datei, selbst eine Binärdatei wie z.B. ein JPEG-Bild. Das liegt daran, dass ISO-8859-1 ein Ein-Byte-Encoding ist, bei dem alle 256 Werte belegt sind.

Es ist also fruchtlos und hinderlich, mit Encode::Guess auf ISO-8859-1 testen zu wollen.

Ist die Unterscheidung von UTF-8 und ISO-8859-1 also nicht möglich?

Doch, sie ist möglich, wenn auch nicht mit den Mechanismen von Encode::Guess allein. Denn auch wenn UTF-8 formal gültiges ISO-8859-1 darstellt, gilt nicht die Umkehrung, dass jeder ISO-8859-1 Text valides UTF-8 darstellt. Es ist sogar sehr unwahrscheinlich, dass ein realer ISO-8859-1 Text, gleichzeitig valides UTF-8 ergibt, beinahe ebensowenig, wie dass ein ISO-8859-1 Text ein JPEG-Bild ergibt.

Unter Berücksichtigung dieser Tatsache können wir die Unterscheidung von ISO-8859-1 und UTF-8 hinreichend sicher vornehmen:

my $dec = Encode::Guess->guess($text);

if (ref $dec) {

$text = $dec->decode($text);

}

elsif ($dec =~ /No appropriate encodings found/i) {

$text = Encode::decode('iso-8859-1',$text);

}

else {

die "ERROR: $dec\n";

}

Erläuterung:

Der Dateiinhalt wird auf die Default-Encodings ascii, utf8, UTF-16/32 mit BOM - also Unicode - geprüft.

Falls UTF-8 erkannt wurde (oder eines der anderen Unicode-Encodings) nutzen wir das gelieferte Encoder-Objekt um den Text zu dekodieren.

Falls kein Unicode-Encoding erkannt wurde, muss es sich um eine ISO-8859-1 Datei handeln, denn andere Encodings erwarten wir nicht. Wir dekodieren den Text ohne Encoder-Objekt (alternativ) mit der Funktion Encode::decode().

Falls ein sonstiger Fehler eingetreten ist, brechen wir mit einer Exception ab.

Dieser Ansatz ("Wenn etwas nach UTF-8 aussieht, ist es auch UTF-8, sonst betrachten wir es als ISO-8859-1") funktioniert.

Das Ganze als vollständige Implementierung einer Perl-Klasse File mit einer einzelnen Methode decode():

package File;

use strict;

use warnings;

use Encode::Guess ();

# ---------------------------------------------------------------------------

=encoding utf8

=head1 NAME

File - Klasse mit Datei-Operationen

=head1 METHODS

=head2 decode() - Lies und dekodiere eine Textdatei

=head3 Synopsis

$text = $class->decode($file);

=head3 Description

Lies Textdatei $file und liefere den dekodierten Inhalt zurück.

Als Character Encoding erwarten wir Unicode (speziell UTF-8) oder

Latin1 (ISO-8859-1).

=cut

# ---------------------------------------------------------------------------

sub decode {

my ($class,$file) = @_;

# Datei einlesen

local $/ = undef;

open my $fh,'<',$file or die "ERROR: open failed: $file ($!)\n";

my $text = <$fh>;

close $fh;

# Encoding ermitteln und Text dekodieren

my $dec = Encode::Guess->guess($text);

if (ref $dec) {

# Wir dekodieren Unicode

$text = $dec->decode($text);

}

elsif ($dec =~ /No appropriate encodings found/i) {

# Erwarteter Fehler: Wir dekodieren Latin1

$text = Encode::decode('iso-8859-1',$text);

}

else {

# Unerwarteter Fehler

die "ERROR: $dec\n";

}

return $text;

}

# ---------------------------------------------------------------------------

=head1 AUTHOR

Frank Seitz, L<http://fseitz.de/>